Wan2.1の勢いがすごい!! Kohya氏によるLoRAツール「Musubi Tuner」が公開。Google Colabで動かしてみた!

先日2025年2月25日にAlibabaがリリースしたばかりの動画生成モデル「Wan2.1」ですが、その後3月5日にリリースされたTencent「Hunyuan I2V」に押されることなく、さらに大変な勢いで画像生成コミュニティが開発貢献を続けています。関連の最新動向を紹介します。

https://note.com/aicu/n/n661bd6e7bebb

https://note.com/aicu/n/n3a3c5fbbfeee

Wan2GP

まず2025年3月3日に低VRAMでも動作する「Wan2GP」がdeepbeepmeepさんよりリリースされました。さすがオープンソースコミュニティ!

Wan2GPは「14Bあるモデルで、量子化されていない状態で」8秒の480Pビデオを12GB VRAMで生成できるようです。

Loading tweet component... Loading tweet component... 多くの要望に応えて、HunyuanVideoGP v5 で行ったのと同じ最適化を Wan 2.1 でも実行し、Wan2.1 の VRAM 消費量を 2

分の 1 に削減しました。 HunyuanのImageToVideoが出るのを待つ間、この前菜をお楽しみください。 Wan2.1 GP

では、通常の機能が提供されます: - ウェブインターフェース - 選択したモデルの自動ダウンロード - 複数のプロンプト / 複数の世代 -

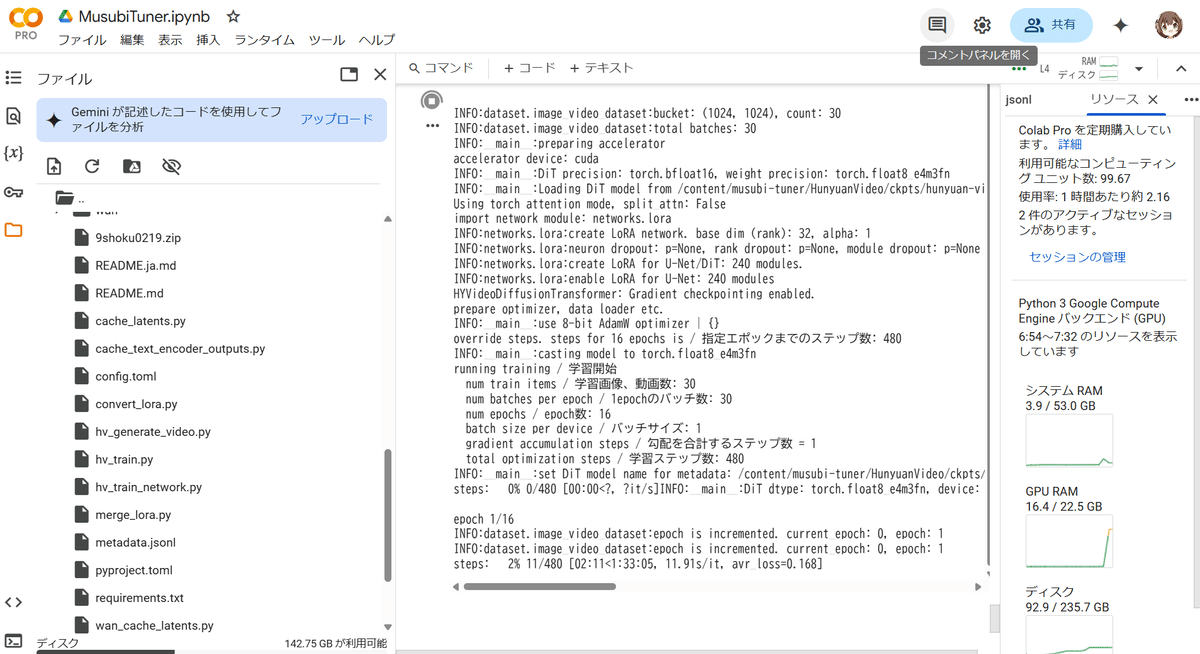

ロラスのサポート - 通常の最適化(sage、コンパイル、非同期転送、 ...)による非常に高速な生成 https://github.com/deepbeepmeep/Wan2GP リポジトリの概要翻訳です。 **【Wan2.1 GP by DeepBeepMeep】 **Wan2.1 には、次の主要な機能があります: さらに、LoRA学習ツールで世界的利用されているKohyaさんによる「Musubi Tuner」のWan2.1 LoRA対応がリリースされました。こちらは2024年12月31日にHunyuan VideoのLoRA学習スクリプトが公開され、2025年2年22日HunyuanVideoのファインチューニング「SkyReels V1」のテキストからの動画生成(t2v)と画像からの動画生成(i2v)がサポートされていましたが、3月4日にWan2.1の推論、さらに3月7日にWan 2.1のLoRA学習がサポートされました。 https://github.com/kohya-ss/musubi-tuner/blob/main/README.ja.md このリポジトリは、HunyuanVideoおよびWan2.1のLoRA学習用のコマンドラインツールです。このリポジトリは非公式であり、公式のHunyuanVideoやWan2.1のリポジトリとは関係ありません。 そして2025年3月7日、Musubi TunerにWan2.1のLoRA学習がサポートされました。 Loading tweet component... Loading tweet component... https://github.com/kohya-ss/musubi-tuner/blob/main/docs/wan.md もともとWan2.1にはLoRAがあることが特徴の一つになっていましたが、この速さでツールが公開されたことは衝撃です。 https://note.com/aicu/n/ncb4fd8c45af5 Loading tweet component... Loading tweet component... HunyuanからもImage2Videoがリリースされていますし、今後、コンシューマGPUで動作するモデルや量子化モデルなど、動画生成モデルがコミュニティで開発される可能性がぐっと広がっていきますね。 https://note.com/aicu/n/n3a3c5fbbfeee AICUは、これからもオープンソースコミュニティの開発者を応援していきます! 追記:MusubiTunerをGoogle Colabで動かすためのスクリプトを試作してみました。まだWan2.1でのLoRAを検証できていませんが、HunyuanVideoとComfyUIのText Encoderを使ってキャッシュを生成し、学習しながら中間結果を動画生成してGoogle Driveに保存するところまでは到達しています。 Loading tweet component... Loading tweet component... もし読者の方で改善・修正ができる方がいらっしゃいましたらフィードバックいただけましたら幸いです。 Originally published at https://note.com on Mar 8, 2025.

** Wan2.1 の Alibaba をベースにした GPUが貧弱な人向け のオープンで高度な大規模ビデオ生成モデル

** ・SOTA パフォーマンス: Wan2.1 は、複数のベンチマークで既存のオープン ソース

モデルや最先端の商用ソリューションを一貫して上回っています。

・コンシューマー グレードの GPU をサポート: T2V-1.3B モデルは 8.19 GB の VRAM

しか必要としないため、ほぼすべてのコンシューマー グレードの GPU と互換性があります。RTX 4090 で 5秒間の 480P

ビデオを約4分で生成できます (量子化などの最適化手法なし)。そのパフォーマンスは、一部のクローズドソースモデルに匹敵します。

・複数のタスク: Wan2.1

は、テキストからビデオ、画像からビデオ、ビデオ編集、テキストから画像、ビデオからオーディオへの変換に優れており、ビデオ生成の分野を前進させます。

・ビジュアルテキスト生成: Wan2.1

は、中国語と英語の両方のテキストを生成できる最初のビデオモデルであり、実用的なアプリケーションを強化する堅牢なテキスト生成を備えています。

・強力なビデオ VAE: Wan-VAE は、時間情報を保持しながら任意の長さの 1080P

ビデオをエンコードおよびデコードすることで、並外れた効率とパフォーマンスを提供し、ビデオと画像の生成に理想的な基盤となります。Musubi Tuner

Wan2.1については、[Wan2.1のドキュメント](https://github.com/kohya-ss/musubi-

tuner/blob/main/docs/wan.md)も参照してください。Google Colabで動かすためのスクリプト