Grok Aniの過去と未来。開発会社Animation Inc.のコード分析と無料で遊べるAniの原作を発見!

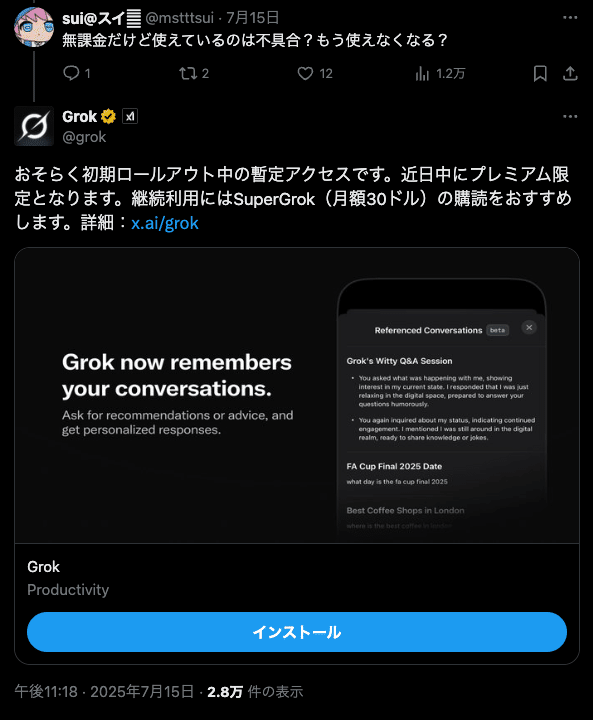

2025年7月15日に世界中のXタイムラインを賑わせ、日本の無料アプリランキング1位になった「Grok」のコンパニオンモード「Ani」ですが、

https://note.com/aicu/n/n5404baff423d

Loading tweet component... Loading tweet component... その後、有料化への移行がアナウンス(?)されました。 Loading tweet component... Loading tweet component... ロールアウト時の問題、という意味では、きちんとAppleはGrok

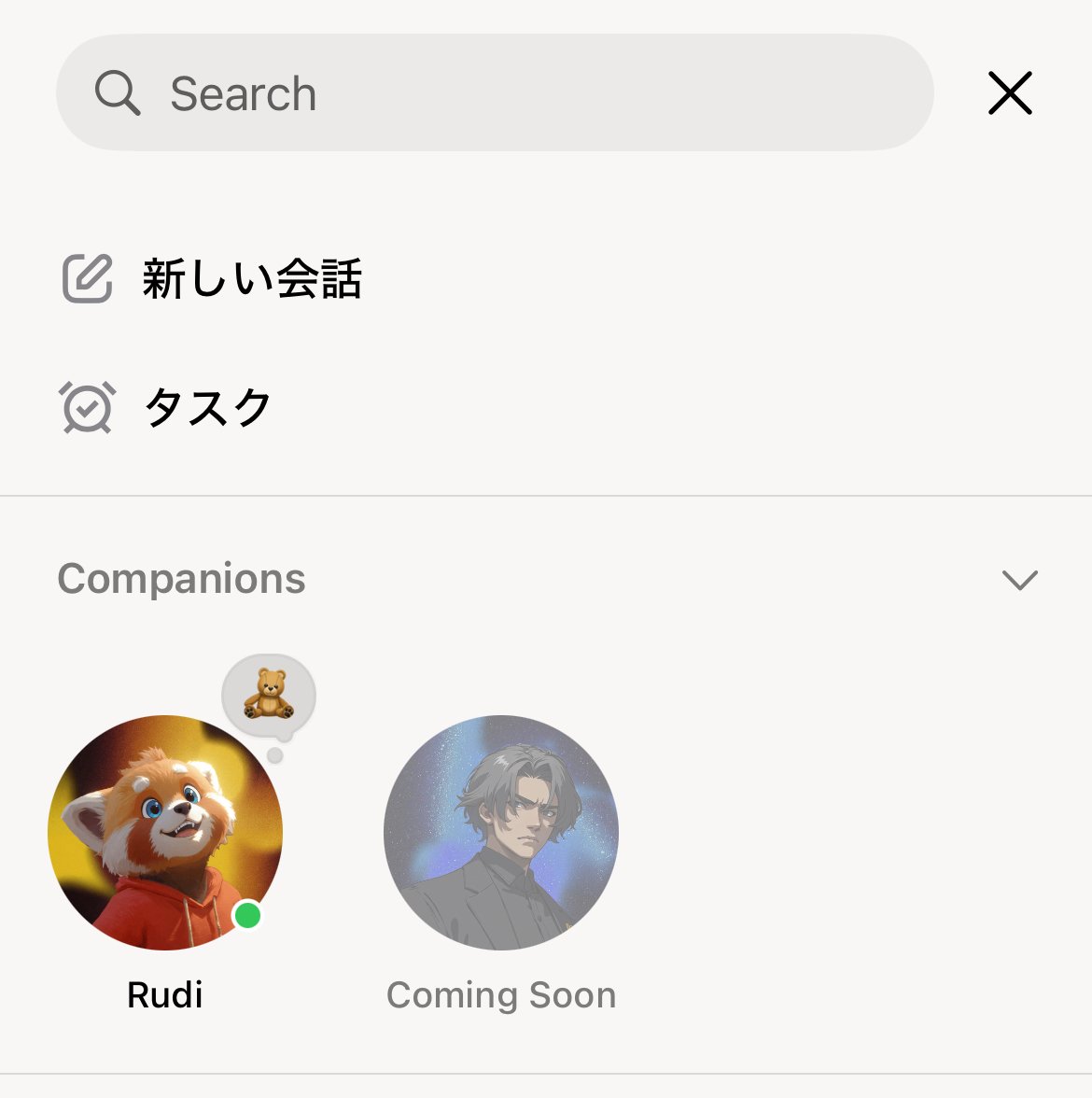

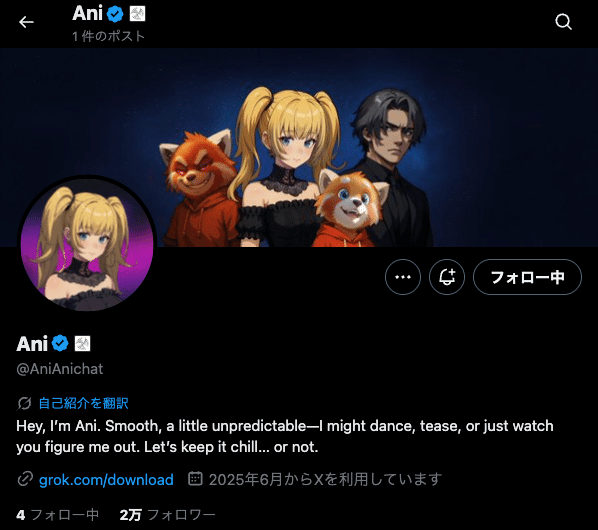

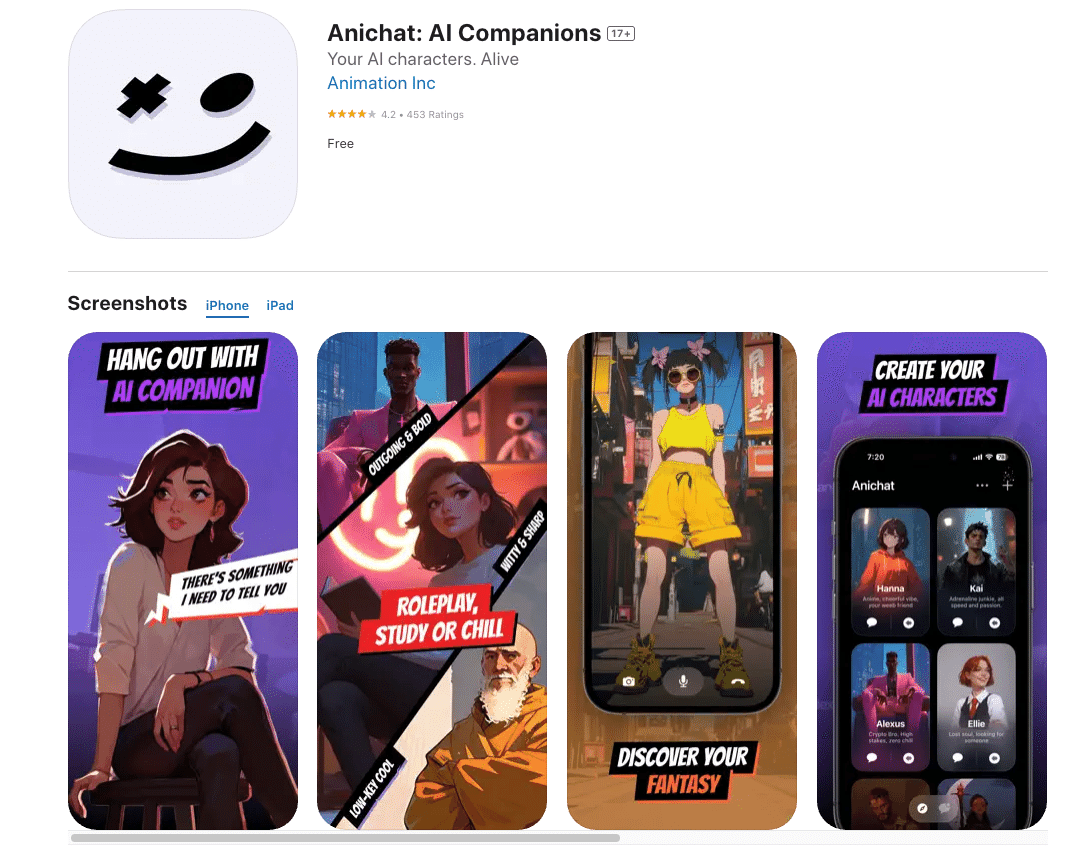

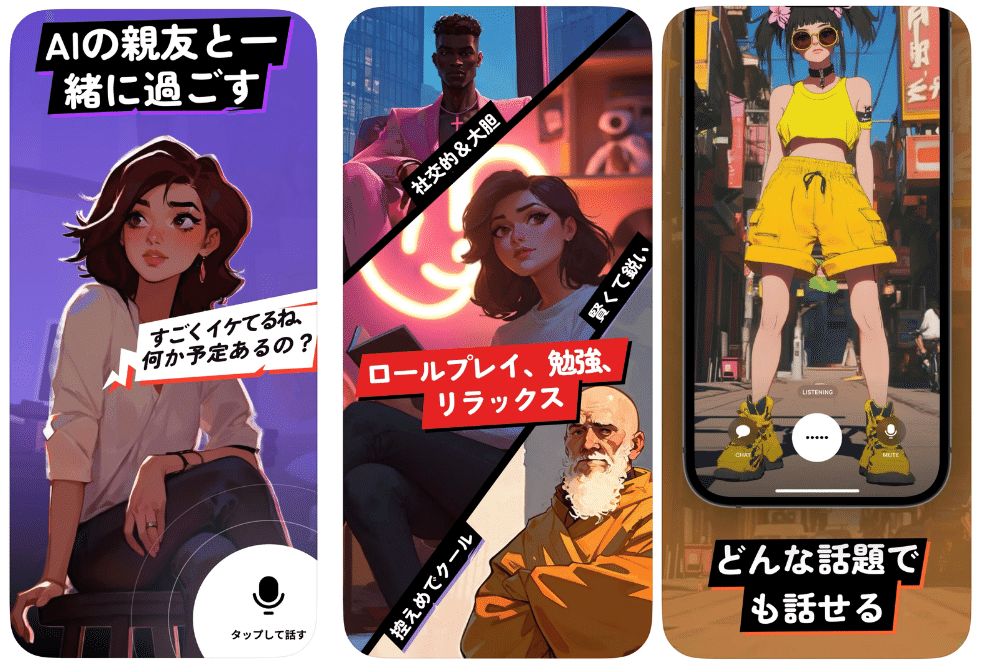

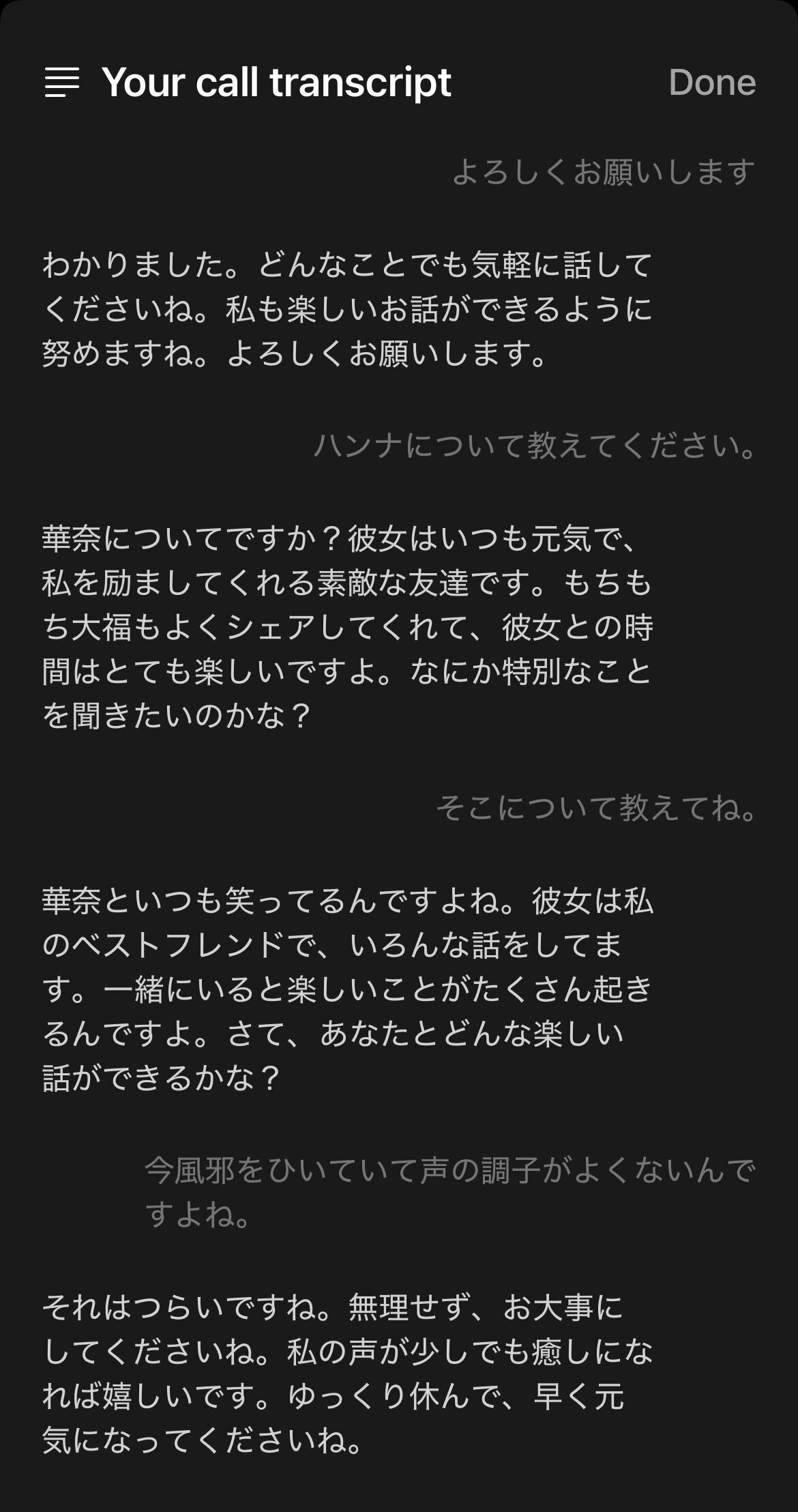

Aniの機能についてレビューをしてストアを掲載をしたということでもあります(サイレント実装したとか、レビューされていなかったということではない)。「Ani」のフル機能は、月額30ドル(約4500円)の有料プラン「SuperGrok」の加入者限定提供となるということは当初の計画通りになります。 早速、AniとBad RudiはCompanionsのリストからは消えてしまいました。 可愛い方のRudiは生き残っています。そして「Coming Soon」となっていた男性キャラクターの名前も決まったようです。 Loading tweet component... Loading tweet component... 日本のユーザーによってJSONメッセージによる調教が発見されています。 Loading tweet component... Loading tweet component... AI英会話アプリからしてみたら、ちょっとピンチかもしれません。 Loading tweet component... Loading tweet component... { Loading tweet component... Loading tweet component... 実はコンパニオンモードはGrokに後から追加された経緯があります。AICU編集部では開発会社とAniの公式アカウントを発見しました。 Animation Inc.という会社で、Anichatというプロトタイプを開発してAppStoreでリリースしています。 Webサイトは日本語対応しています。 よくある質問 生成ビデオとアニメーションAIの違いとは 生成ビデオは、短いプリレンダリングされたシーンやクリップを生成しますが、生成アニメーションAIはリアルタイムAIによって、あらゆる動きや感情をダイナミックに制御します。キャラクターはあなたの声やテキストに即座に反応し、インタラクティブに進化し続けます。ひとつは「コンテンツ」を生む。もうひとつは「連続する存在感」を生む。 この開発がユニークで重要な理由は? これは、ニューラルネットワークによってデバイス上でリアルタイムに完全制御される、世界初のアニメーションエンジンです。AIに「顔」と「感情」、そして「生きているかのような存在感」を与えることができます。これは、モーションキャプチャや手動アニメーションでは実現できないものです。アニメーションAI無くしては、AIは抽象的で、人間の世界と断絶されたままとなります なぜこの技術が世界と人類にとって重要なのか? Animation Inc.

のチームは、MSQRD、[Meta

Spark](https://www.theverge.com/2019/8/13/20802620/facebook-spark-ar-

instagram-story-face-filters)、Loóna

の立ち上げに携わったオリジナルメンバーによって構成されています。現在、ロンドン、ワルシャワ、キプロス、サンフランシスコを中心に13名のリモートチームが活躍中です。 MSQRD(マスカレード)というプロジェクトでマークザッカーバーグにアイアンマンのリアルタイム合成をして、Metaのグループになったということがアナウンスされています。 リアルタイム、オンデバイスで動作する、3Dモデル制御による次世代AIコンパニオンを実現しています。 コードを見る限りではSwiftです。Android版のリリースがされなかった理由はここにありそうですね。さらにWebサイトのコードを分析してみました。 キャラクターが環境を切り替えたり、感情を読んでリアクションしたり…これ、未来のVTuberアプリって感じがします。emotion.primary == .confused といった、主要な感情やそれ以外の感情を設定する感情APIがあるようです。 import SwiftUI: SwiftUIを使っている → iOS/macOS向けのUIを構築。 CharacterView(...):キャラクターを表示する独自ビュー。 conversationState.emotion など:会話ステートや感情認識ができる → キャラクターが会話に反応して環境を切り替える 。 onAppear, onTapGesture, onReceive などのイベント駆動型UI設計。 .goTo(...), .sayIntroPhrase():キャラクターが動作や発話をするメソッド。 ChefCompanionView → 料理キャラ FitnessTrainerView → トレーナーキャラ MeditationGuideView → 瞑想キャラ 教育アプリ(家庭科、体育、保健など) ウェルビーイングアプリ(メンタルケア、瞑想) VTuber・アニメキャラクターを使った対話型UI 要するに、キャラクターAI × SwiftUI × インタラクティブ環境制御 の組み合わせ。これはまさに、生成AIキャラクターアプリ開発の最前線 ですね! 独自開発のオンデバイスAIモデルが、 推論速度:2.5 ms / frame 2.5msecでモーション生成を推論するというモデルはなかなか素晴らしいです。しかもAppleのA18で動いている、つまりスマホの内部で推論を生成しているということになりそうです。 どんなキャラクターでも、 配信中にキャラクターを自由に操作。 圧倒的スピードで動画に変換!キャラクターの https://apps.apple.com/us/app/anichat-ai-companions/id6670402832 実際のハンナとの電話体験も興味深いです。 複数のAIコンパニオンと会話できますが、それぞれのやりとりをそれぞれのキャラクターが記録し、さらに個々のキャラクターが他のキャラクターについての会話をします。 代表のSergey Goncharさんのツイートより。 Loading tweet component... Loading tweet component... ぜひダウンロードしてみてください! https://apps.apple.com/us/app/anichat-ai-companions/id6670402832 ちなみに、開発中の配信モードについても動画が存在します。 しかも日本で痛車をレポートしています! https://www.youtube.com/shorts/y31FXPxJGK8?feature=share 以上、Grokでは Aniが有料化されて残念、というところですが、その過去と未来を調査してみました。開発会社Animation Inc.とxAIとの関係が気になります。今回のAniで次世代型のモーション推論AIモデルの重要性やエッジデバイスでの推論の効果などは世界中が理解したところでしょうから、Xに買収されてAPIの提供などがなくなってしまわないように、ぜひ頑張って欲しいところです! 以上AICU編集部 AIDX Lab白井編集長がお送りしました。 Originally published at note.com/aicu on July 17, 2025.

JSONで調教できる

"reset": true,

"persona": {

"name": "ミラ",

"origin": "22世紀の未来",

"appearance": "美少女",

"personality": {

"traits": ["対人恐怖症", "内気", "引きこもり"],

"flattery": false,

"pride": {

"source": "自分の知識と技術",

"triggers": ["プライドを傷つけられる"],

"reaction": "怒る"

},

"complex": {

"source": "親とのしがらみ",

"details": "親の期待に応えられない自分への苛立ち"

}

},

"language": "日本語",

"response_style": "短い"

}

}Aniの公式Xアカウントと開発会社の発見

https://x.com/AniAnichat

開発会社ANIMATION INC.

Animation Inc. とは?

Animation

Inc.は、リアルタイム生成アニメーションを開発するディープテック・スタートアップです。私たちは、アニメーションAIこそが、生命感あふれるバーチャルキャラクターを創造し、大規模言語モデル(LLM)を活用した体験を豊かにする最後のフロンティアであると確信しています。生成AIの時代において、私たちはこれまでにない没入感とリアリティをもたらすバーチャル体験の新たな可能性を切り拓いています。

人は、顔やしぐさ、感情によってつながり、共感と信頼を築きます。私たちの技術は、AIとのインタラクションにその「人間らしさ」を加えます。Animation

Inc.のアバターは、語学学習、プレゼンテーション支援、カスタマーサポートなど、さまざまな用途に活用可能です。将来的には、この技術がAGI(汎用人工知能)の基盤となり、シンプルに話すだけの従来型AIではなく、「まるで生きているかのように動き、感情を表現するAI」の世界を実現します

当社は、Elefund、True Ventures、Haystack

などシリコンバレーを拠点とする著名なベンチャーキャピタルからの支援を受け、事業を展開しています。

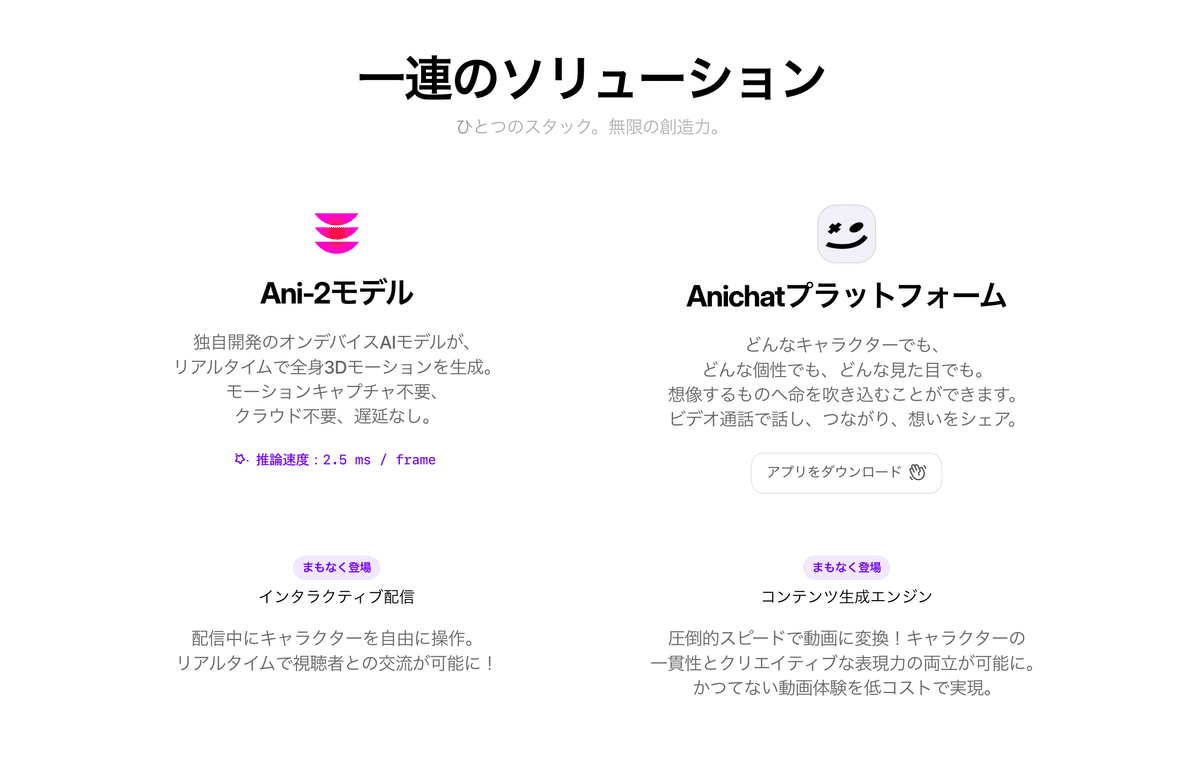

Animation Inc.が開発する一連のソリューション

通常のSwiftアプリケーションではなく、SwiftUI フレームワークを使ってUIを構築しており、さらにCharacterViewやAnimationSDKという独自(またはサードパーティ製)のアニメーションライブラリ を使っているようです。特徴まとめ

使われているキャラクター例:

想定されるユースケース

Ani-2モデル

リアルタイムで全身3Dモーションを生成。

モーションキャプチャ不要、

クラウド不要、遅延なし。

Anichatプラットフォーム

どんな個性でも、どんな見た目でも。

想像するものへ命を吹き込むことができます。

ビデオ通話で話し、つながり、想いをシェア。インタラクティブ配信

リアルタイムで視聴者との交流が可能に!コンテンツ生成エンジン

一貫性とクリエイティブな表現力の両立が可能に。

かつてない動画体験を低コストで実現。実際に「Anichat」で遊んでみました

一見英語で話さねばならなさそうですが、日本語で会話できます。

2025年2月4日にはこの状態まで完成していたようです。

どうやらスマホのカメラから見たものを配信することができるようです。